由于高昂的能源成本和监管的不确定性,ChatGPT 开发商 OpenAI 已暂停其名为“Stargate UK”的旗舰数据中心项目。该项目原属于一项耗资310亿英镑(约 400 多亿美元)的宏大投资计划,旨在扩大英国的人工智能(AI)基础设施。

该计划最初拟部署8000块GPU,并计划最终扩展至31000 块。其核心目标是提升英国的“主权算力(Sovereign Compute)”能力,即通过建设本土基础设施支持AI研发,减少对国外系统的依赖。

然而,该公司目前已停止了开发进程。OpenAI 发言人表示:

“……我们支持政府成为AI领军者的雄心。AI算力是实现这一目标的基础。我们将继续调研 Stargate UK 项目,并在监管环境和能源成本等条件能够支撑长期基础设施投资时,再推行该项目。”

能源成本成核心制约因素

问题的症结在于能源。AI 数据中心运行GPU阵列和冷却系统需要消耗海量电力。

在英国,工业电价处于发达经济体中的最高水平。近期估算显示,英国电价约为每兆瓦时168英镑,而法国仅为69英镑,德克萨斯州仅为38英镑。这一巨大的成本差距使大规模数据中心投资处于明显的竞争劣势。

AI工作负载属于能源密集型。一个大型数据中心的耗电量相当于数万个家庭的总和。随着 AI 普及率的提高,这种需求正在迅速增长。

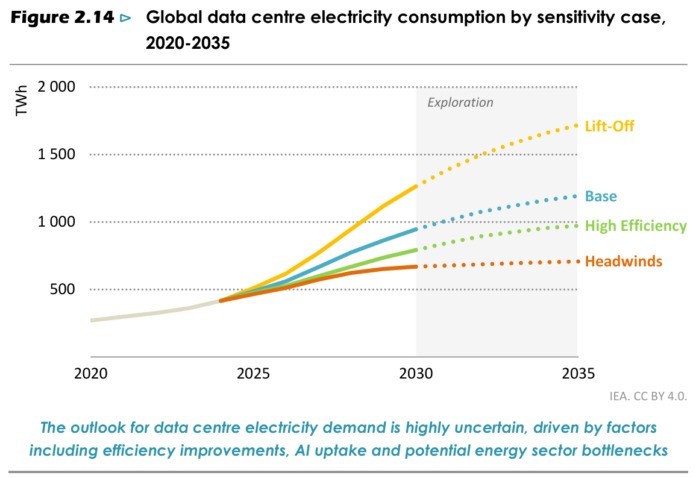

根据国际能源署(IEA)的预测,全球数据中心的耗电量可能从 2024 年的约 415 亿千瓦时(TWh)飙升至 2030 年的 1,000 亿千瓦时以上。这一增长很大程度上是由 AI 驱动的。

来源:IEA

结论显而易见:能源已不仅仅是一项经营成本,它已成为决定 AI 基础设施选址的关键因素。

监管层面的潜在风险

能源只是挑战的一部分,监管政策也在拖慢投资步伐。在英国,围绕AI规则(尤其是训练数据的版权法)的不确定性令企业犹豫不决。

此前有关允许AI公司使用受版权保护内容的提案在遭到抵制后被撤回,这导致企业在合规性方面缺乏明确的指导。

对于大型基础设施项目而言,这种不确定性增加了风险。数据中心需要数十亿美元的前期投入,在投入资本之前,企业需要稳定的政策环境。

此外,规划审批的延迟和电网接入的时间表也增加了阻力,进一步推高了成本并拉长了项目周期。高昂的能源成本与监管不确定性交织在一起,为超大规模 AI 基础设施的建设创造了艰难的环境。

OpenAI全球基础设施:布局更趋理性

尽管暂停了英国项目,这家ChatGPT制造商仍在全球范围内扩张。通过与微软(Microsoft)、英伟达(NVIDIA)和甲骨文(Oracle)合作,该公司正大举投资AI基础设施。此外,它还与美国一项更大规模、耗资5,000亿美元的“Stargate”计划相关联,专注于构建下一代 AI 数据中心。

与此同时,该公司也面临着成本攀升的压力。有报告显示,随着OpenAI为满足需求而扩大基础设施规模,其每年的亏损可能达数十亿美元。

这反映了行业的整体转型:AI 正变得越来越像能源或电信基础设施,需要巨额资本投入、极长的周期以及稳定的经营环境。此次暂停也揭示了一个更深层的问题:AI 的增长正在加剧能源系统和环境的压力。

每一条AI查询背后隐藏的碳成本

ChatGPT及类似工具依赖大型数据中心。这些设施目前约占全球电力消耗的1%至1.5%。由于多种变量影响,对其未来能源消耗的预测差异很大。

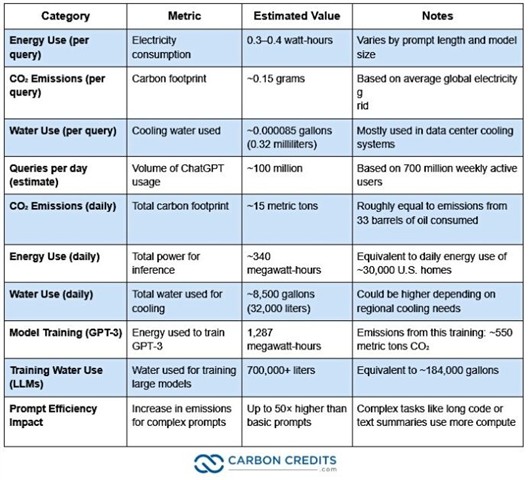

单次查询的影响看似微不足道——一次典型的ChatGPT请求耗电量约为 0.3 瓦时,处于较低水平。但随着规模的扩大,情况发生了变化。

目前ChatGPT服务于数亿用户,即便是微小的单次功耗,累积起来也非常可观。而模型训练的能耗则更为惊人。例如,训练GPT-3需要约1287兆瓦时的电力,并产生约550公吨的二氧化碳。

更新、更大的模型能耗更高。据估计,训练GPT-4这种先进模型可能会排放高达15000公吨的二氧化碳,具体取决于能源来源。

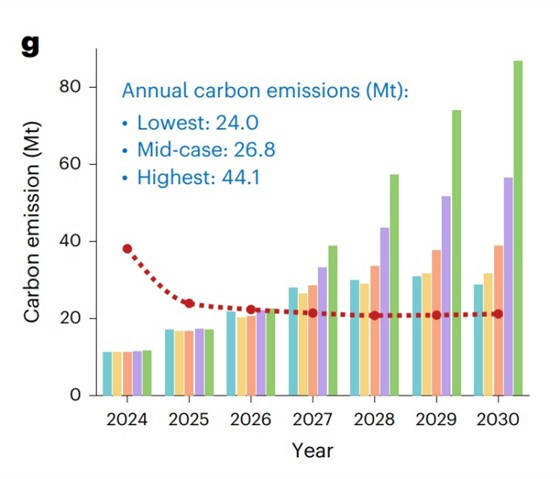

从系统层面看,其影响正在快速增长。仅在2025年,AI系统就可能产生3260万至 7970万吨的二氧化碳排放。到2030年,AI 驱动的数据中心每年可能新增 2,400 万至 4,400 万吨二氧化碳排放。

注: 不同情景下 2024-2030 年 AI 服务器的碳排放量(单位:克)。图表 e-g 中的红色虚线表示根据过往文献预测的美国数据中心碳足迹。

展望未来,如果增长趋势持续,到 2035年全球生成式AI的年排放量可能达到2.45亿吨。这些数据呈现出一个清晰的模式:虽然能效在提高,但总需求的增长速度远超效率的提升。

科技巨头在 AI 增长与减排之间寻求平衡

OpenAI 尚未发布详尽的独立净零排放目标。然而,其运营高度依赖合作伙伴(如微软),而微软已承诺到 2030 年实现负碳排放。

该公司承认能源消耗是一个现实担忧。其领导层指出,需要更多的可再生能源(包括核能和清洁电力)来支撑 AI 的增长。

在整个行业,企业正在通过以下几种方式进行应对:

优化模型效率: 降低单次查询的能耗。

投资可再生能源: 签署长期购电协议。

探索新型冷却系统: 减少水资源和能源消耗。

能效提升的效果已经显现。部分AI系统在一年内将单次查询能耗降低了30多倍,展示了技术的快速迭代。然而,由于需求规模的增长超过了效率的增益,总排放量仍在持续上升。

全球 AI 基础设施竞赛

英国项目的暂停突显了一个大趋势:AI 基础设施正演变为一场由能源、政策和成本决定的全球竞赛。

拥有较低电价和更快捷审批流程的地区正占据优势。美国和中东部分地区凭借廉价电力和支持性政策,正吸引着大规模的 AI 投资。

与此同时,各国政府也在努力吸引此类项目。英国虽承诺投入数十亿英镑支持 AI 增长并提升算力,但此案例表明,仅有政策雄心是不够的。企业需要的是可靠的能源供应、明确的规章制度和可预测的成本支出。

AI 的下一阶段:由能源而非代码决定

OpenAI的决定并不意味着缩减AI投资,而是反映了优先事项的转移。

企业在基础设施选址上正变得愈发挑剔,重点关注能够提供能源获取、成本稳定性和监管透明度最佳组合的地区。

英国项目未来仍有可能推进,但前提是环境有所改善。目前,信号非常明确:AI 的未来将不仅由技术塑造,还将取决于能源系统、政策框架以及长期的投资条件。

资料来源:carboncredits

参与评论 (0)