当大语言模型(LLM)从云端对话框走进实体居住空间,其面临的挑战已不再是单纯的“文笔”好坏,而是响应时延与场景认知的硬核考验。

近日,Google Home 对其 Gemini AI 进行的一次“微小”提速,实际上为整个智能家居行业揭示了 AI 模型落地过程中必须跨越的真实鸿沟。

1.5 秒的“生死线”

自 2025 年末 Google 引入 Gemini 以来,虽然语音交互的自然度大幅提升,但用户端的反馈却指向了一个共同的痛点:慢。

在智能家居的交互逻辑中,延迟是用户体验的杀手。Google 官方在最近的更新补丁中明确提到,通过优化,Gemini 的命令处理速度提升了 1.5 秒。这侧面证实了在优化前,LLM 在解析复杂指令时存在明显的感知延迟。

对于网页端 AI 助手,几秒钟的等待是“思考”;但对于智能家居,超过 1 秒的开关灯延迟就是“故障”。这正是 ChatGPT、Claude 等通用 LLM 在转化为家电控制逻辑时面临的头号难题。

LLM 为何在家里“变迟钝”了?

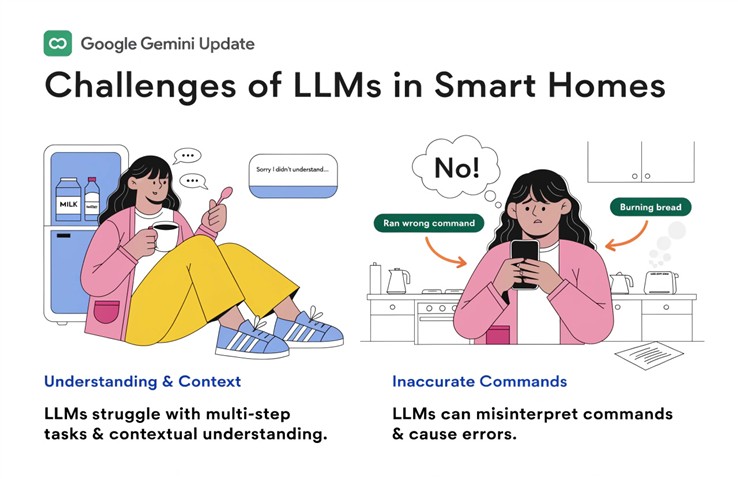

有文章分析指出,Gemini 此前的卡顿并非算力不足,而是由于 LLM 固有的处理深度 与 家庭环境复杂性 之间的博弈。Google 此次采取了双管齐下的优化策略:

端侧逻辑优化(Device-level Optimization): 减少云端往返,提升设备层级的响应精度。

空间语义理解(Home Layout Interpretation): 强化 AI 对家庭布局和设备拓扑结构的认知,缩短指令与物理设备之间的“映射路径”。

多轮对话判别: 提升 Gemini 对“独立指令”与“连续追问”的识别率,减少因误解语境导致的交互冲突。

行业启示:专业集成商应关注什么?

这不仅仅是 Google 的小修小补,对于专业级控制系统(如 Savant, Crestron, Control4)的开发者和集成商(SI)来说,这是极具价值的“前哨战”信号:

延迟是 AI 商业化的最大障碍: 既然连 Google 都在为 1.5 秒的提速而努力,说明目前 LLM 在实现“即时反馈”上仍有底层限制。

软件迭代是风向标: 集成商应密切关注这类大厂的补丁日志。这些更新不仅代表了技术的进步,更揭示了 AI 在处理物理空间、多用户干扰、离线控制等极端场景时的局限性。

专业平台的护城河: 相比消费级 AI 的“边走边改”,专业控制平台在引入 AI 时会更加谨慎。Google 遇到的这些坑,正是专业系统正在秘密打磨、试图领先解决的核心痛点。

总结:从“能对话”到“真智能”

Google Gemini 的这次更新,是 LLM 试图克服“水土不服”的一次重要尝试。智能家居的未来不取决于 AI 会说多少段子,而取决于它能否在 0.5 秒内精准理解并执行“帮我调暗卧室灯光”这种模糊指令。

在 AI 赋能的下半场,响应速度、空间拓扑认知、指令容错率 将成为衡量一个智能系统是否“及格”的硬指标。建议集成商在为高端客户推荐方案时,不要盲目迷信 AI 的“对话能力”,而应更多考察系统在复杂逻辑下的执行稳定性。

参与评论 (0)