AI算力激增重塑数据中心:五大电力难题待解

随着人工智能训练与推理规模的不断提升,GPU集群、高功率密度机架和大规模横向扩展架构逐渐成为数据中心的新常态。传统面向稳态IT负载而设计的电力系统,正被快速增长、瞬态频繁、结构更复杂的AI工作负载重新定义。为了在高功率密度、强波动性和快速迭代的环境中保持可靠运行,数据中心必须重新审视其电力系统架构与管理模式。

以下从五个关键维度系统性分析AI数据中心面临的主要电力挑战。

挑战一:传统电力架构难以适应AI数据中心的快速演进

传统数据中心的设计假设是稳态负载、固定容量、长周期升级,但AI的出现彻底改变了增长曲线与建设逻辑:

AI发展带来两大趋势:

- 电力需求激增与升级周期缩短:快速演进的GPU平台让电力基础设施需要更频繁、细粒度的扩容。

- 传统集中式架构难以满足灵活性:固定路径、不可扩展的电源设计会成为高密度部署的瓶颈。

因此,AI数据中心必须走向更模块化、可演进、可协调升级的电力架构。

挑战二:机架功率密度迅速提升,加剧配电与热风险

在AI环境中,机架功率密度已远超传统水平:

- 过去:5–10kW/机架

- 现在:40–60kW常见,高端部署超过80–100kW

高密度导致三大关键压力:

1.分支容量与相位平衡压力倍增

功率提升意味着更严格的相位平衡要求,任何局部不平衡都可能导致过载或跳闸。

2.热量积聚增加

功率越集中,热密度越高,机架内部电源组件、连接点与线缆的温升都会显著增加。

3.产能效率下降

即便机架物理空间足够,电力和散热不足仍会导致“空间可用但功率不足”的闲置现象,限制硬件部署效率。

随着GPU集群继续向更高功率推进,机架级配电已经成为AI数据中心最直接的瓶颈之一。

挑战三:动态AI工作负载对电力稳定性提出新要求

AI训练负载具备高度瞬态特征,尤其在大规模GPU集群中,多卡同步运算会导致功耗在毫秒级出现大幅波动。

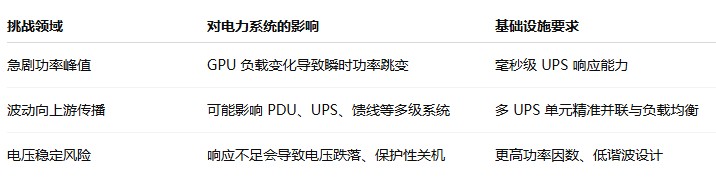

典型影响如下:

AI工作负载的特性使得传统以“稳态设计”为主的架构不足以应对频繁的动态波动,系统必须具备:

- 更快的瞬态响应

- 更高的电气稳定性

- 更智能的负载管理能力

挑战四:电力供应与散热需求深度耦合,冷却难题加剧

在AI数据中心中,1W电力几乎等于1W热量。因此,任何功率增长都会直接推高热密度。

随着机架功率向100kW+演进,冷却能力成为限制AI机架部署速度的关键因素。

不同冷却方式的能力区间如下:

- 传统风冷:<30–40kW/机架

- 增强型空气冷却:40–60kW

- 液冷(芯片直冷/CDU):60–100+kW

- 浸没式冷却:100kW+

主要难点包括:

- 电力与冷却容量不匹配:电力可用但冷却不足导致产能浪费。

- 热稳定性风险加大:高功率密度对热缓冲空间要求更高。

- 基础设施升级节奏不一致:电力与冷却系统往往无法同步扩容。

因此,AI数据中心必须采用电力–冷却协同规划,从机架级到系统级都要保持同步设计。

挑战五:可视性不足限制规划与扩展,亟需更精细的监控系统

传统监控只覆盖:

- 机房级

- UPS级

- 或机架级

但AI数据中心需要更细粒度、更实时的可视性,以便应对高密度和动态负载,例如:

- 相位级监控

- 分支电路级监控

- 插座级监控

- GPU集群负载实时电力曲线

缺乏精细监控会带来:

- 难以及时发现相位不平衡或局部过载

- 难以优化容量与部署规划

- 冗余与负载均衡不透明

- 扩容决策滞后

同时,传统配电结构的扩展性不足也会限制AI部署节奏。

AI数据中心的未来趋势包括:

- 端到端精细化监测:实现全路径实时可视化。

- 容量洞察+智能冗余管理:提升规划准确性与可靠性。

- 模块化、可扩展架构:适应持续增长与快速迭代。

总结

AI工作负载正推动数据中心向更高功率、更大规模、强瞬态和高度模块化方向发展。与之匹配的电力系统必须具备:

- 更强的稳定性与瞬态响应

- 更高的可扩展性和灵活性

- 更全面的监控与可视化能力

- 电力–冷却协同优化能力

未来的AI数据中心将不再只是“更大功率”的基础设施,而是一个能够动态适应负载变化、高度模块化、实现深度可视化的复杂生态系统。

参与评论 (0)